DeepEP 是一個針對(MOE)和專家並行性(EP)的混合通信庫。它提供了高通量和低延遲的全 gpu 內核,它們稱之為 MOE 調度和組合。同時支持低精度的操作,包括 FP8。DeepSeek 公佈本星期將會是開放源碼週(OpenSourceWeek),並將會相繼推出五個開源軟件庫。他們昨日已經開放第一個代碼庫 FlashMLA。DeepSeek 今日繼續開放創新的底層架構 DeepEP,是首個用於 MoE 模型訓練和推理的 EP 通信庫 。

谷歌的 Titans 架構靈感來自人類記憶方式,包括短期、長期和持久記憶。Titans 的長期記憶能夠主動搵出相關資訊及時更新,而持久記憶就可以儲存推理技能,因此能夠擴展前文後理,並且能夠保持高準確性。

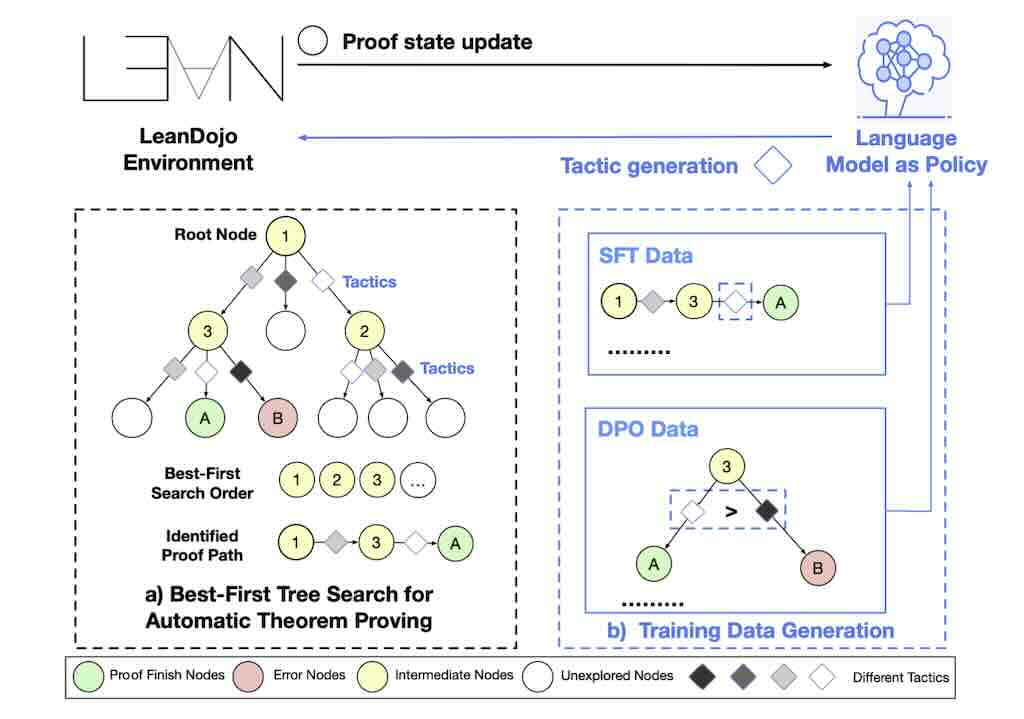

最佳優先搜尋 (BFS Best-First Tree Search) 是一種樹狀搜尋演算法,它透過優先從機率最高的節點來運作,屬於簡單和效率演算法,但普遍認為對於證明定理並不是最理想的方法。 BFS-Prover 挑戰了傳統觀點,

提出一種可擴展的專家疊代框架,主要包含了三個創新點:一是策略性數據過濾,二是利用編譯回饋進行直接偏好優化 (DPO) Direct Preference Optimization,三是長度正規化。

影片主要探討多模態嵌入模型 (Multimodal Embedding Models) 與檢索增強生成 (Retrieval-Augmented Generation, RAG) 的應用。作者討論了 Voyage AI 的多模態嵌入模型,並強調模型能有效地將圖像與文字等多種模態的資料整合到同一的嵌入空間,由於傳統的 CLIP 模型在多模態檢索和 RAG 應用中存在模態差距等問題,而 Voyage AI 可以直接將不同模態的資料轉換為 tokens 並輸入 Transformer 編碼器,解決了這些限制。

Google PaliGemma 2 mix 是 Gemma 系列中的一個升級版視覺語言模型,能夠處理多種任務。PaliGemma 2 mix 能夠直接用於大部份常見的場景,提供了不同大小的模型,分別為(3B、10B 和 28B 參數),解析度亦有兩種模式,分別是(224 和 448 像數)。模型擅長處理短文和長文的生成、光學字符識別、影像問答、物件偵測和影像分割等任務,並且可以搭配 Hugging Face Transformers、Keras、PyTorch、JAX 和Gemma.cpp 等工具使用。

透過 Gemini 2.0 API 和 Next.js 框架,作者分享了如何建構一個實時多模態應用程式。佢能夠接收影像和語音輸入,並透過 WebSocket 傳送至 Gemini API。Gemini API 會生成音頻輸出和文字轉錄,然後整合到有互動功能的聊天介面。教學包括深入探討應用程式的各個組件部分,例如媒體擷取、音訊處理、WebSocket 連線、轉錄服務以及用戶介面的更新。作者亦提供了開源的程式範例,並且逐步加以說明,方便大家由 GitHub 複製,並執行這應用程式。

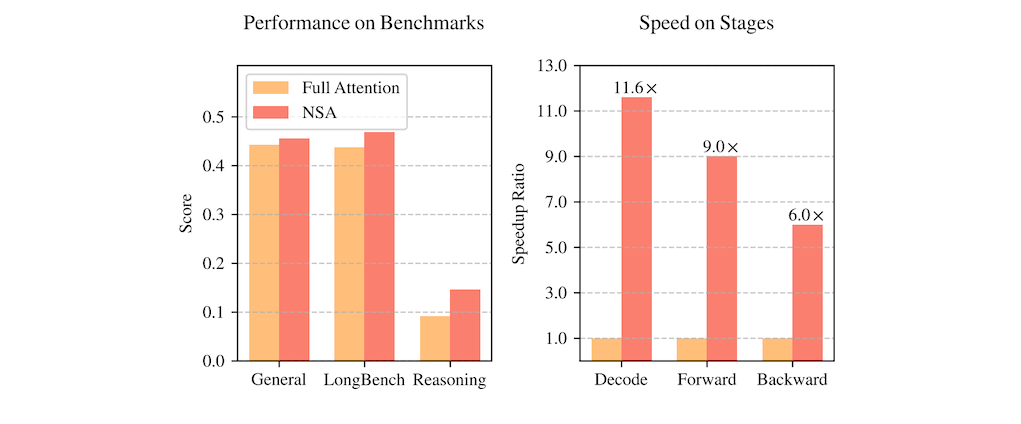

2025 年 2 月 16 日,DeepSeek 提出了一種名為「原生稀疏注意力」(NSA)

Natively trainable Sparse Attention 的新型注意力機制,目的是解決長傳統注意力機制運算量過大的問題。NSA 透過結合分層式 Token 壓縮與硬體加速設計,達成既能有效處理長文本,又不會顯著增加運算負擔的目標。其核心創新點在於演算法與硬體協同優化,保持甚至超越完整注意力模型的性能。實驗證明,NSA 在多項基準測試中表現出色,並且在解碼、前向傳播和反向傳播階段都顯著加速。

只要輸入 5 秒的聲音樣本,就可以體驗到 TTS 的聲音轉換,俗稱 “變聲”。而僅需要 1 分鐘的語音訓練數據,就可以微調模型,提升語音的相似度。GPT-SoVITS 目前支持英語、日語、韓語、粵語和中文。提供的 Web 工具令 TTS 操作相當方便,甚至提供歌曲與伴奏分離、自動語音訓練、中文自動語音識別(ASR)和文本標注,協助初學者創建訓練數據集和 GPT / SoVITS 模型。

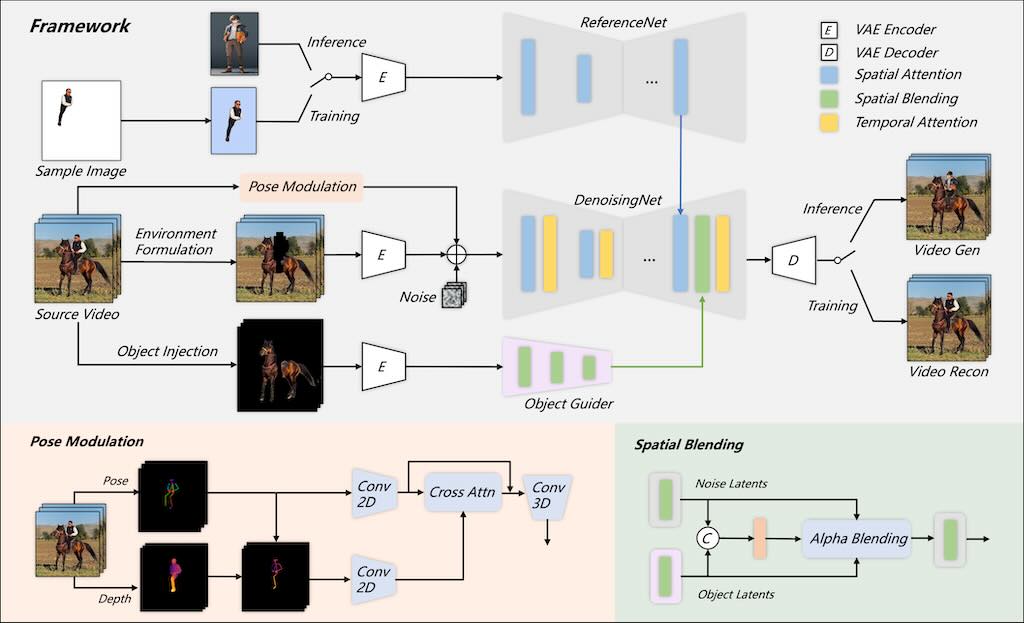

阿里巴巴推出影片框架 Animate Anyone 2。這是一種新的角色圖像影片框架,能夠解決目前無法在影片中的角色與環境之間建立合理關聯。Animate Anyone 2 由輸入的影片中提取環境訊息,通過一種與形狀無關的遮罩策略來更好地描述角色與環境之間的關係,從而提高物件互動的真實性,最終能夠產生高品質的替換角色影片。